Obrázky generované umělou inteligencí ohrožují vědu – tak je chtějí výzkumníci rozpoznat

Vědci bojují proti falešným obrázkům generovaným umělou inteligencí ve vědeckých publikacích. Vyvíjejí se nové metody detekce.

Obrázky generované umělou inteligencí ohrožují vědu – tak je chtějí výzkumníci rozpoznat

Vědci manipulují s čísly a hromadně vyrábějí falešné papíry Povinní vydavatelé – problematické rukopisy byly ve vědecké literatuře dlouho nepříjemností. Vědečtí detektivové pracují neúnavně, odhalit toto provinění a opravit vědecký záznam. Ale jejich práce je stále obtížnější, protože se objevil nový, mocný nástroj pro podvodníky: generativní umělá inteligence (AI).

„Generativní AI se vyvíjí velmi rychle,“ říká Jana Kryštofová, Image Integrity Analyst ve společnosti FEBS Press v Heidelbergu, Německo. "Lidé, kteří pracují v mé oblasti - integrita obrazu a zásady publikování - se stále více zajímají o možnosti, které to představuje."

Snadnost, s jakou texty generativních nástrojů AI, obrázky a data vzbuzují obavy ze stále nespolehlivé vědecké literatury, která je zaplavena falešnými čísly, rukopisy a závěry, které je pro člověka obtížné odhalit. Už se objevují závody ve zbrojení, na kterých odborníci na integritu, vydavatelé a technologické společnosti pilně pracují Vyvíjet nástroje AI, což může pomoci rychle identifikovat klamavé prvky generované umělou inteligencí v odborných článcích.

"Je to děsivý vývoj," říká Christopher. "Ale jsou tu také chytří lidé a navrhují se dobré strukturální změny."

Odborníci na integritu výzkumu uvádějí, že ačkoliv text generovaný umělou inteligencí je za určitých okolností již povolen mnoha časopisy, použití takových nástrojů k vytváření obrázků nebo jiných dat může být považováno za méně přijatelné. „V blízké budoucnosti budeme možná v pořádku s textem generovaným umělou inteligencí,“ říká Elisabeth Bik, specialista na image forenzní specialista a konzultant v San Franciscu v Kalifornii. "Ale dělám čáru, pokud jde o generování dat."

Bik, Christopher a další naznačují, že data, včetně obrázků, vytvořená pomocí generativní umělé inteligence jsou již široce používána v literatuře a že povinní vydavatelé používají nástroje umělé inteligence k vytváření objemných rukopisů (viz ‚Kvíz: Dokážete rozpoznat padělky umělé inteligence?‘).

Identifikace obrázků vytvořených umělou inteligencí představuje obrovskou výzvu: pouhým okem je často téměř nelze rozeznat od skutečných obrázků. „Máme pocit, že se s obrázky generovanými umělou inteligencí setkáváme každý den,“ říká Christopher. "Ale pokud to nemůžete dokázat, můžete udělat opravdu velmi málo."

Existuje několik jasných příkladů použití generativní umělé inteligence ve vědeckých obrázcích, jako je např nyní nechvalně známý obraz krysy s absurdně velkými genitáliemi a nesmyslné štítky, vytvořené pomocí obrazového nástroje Midjourney. Grafika, kterou v únoru zveřejnil odborný časopis, vyvolala na sociálních sítích bouři a byla staženo o několik dní později.

Většina případů však není tak jednoznačná. Figurky vytvořené pomocí Adobe Photoshopu nebo podobných nástrojů před příchodem generativní umělé inteligence – zejména v molekulární a buněčné biologii – často obsahují výrazné rysy, které mohou detektivové rozpoznat, jako je identické pozadí nebo neobvyklý nedostatek pruhů či skvrn. Postavy generované AI často takové vlastnosti nevykazují. "Vidím spoustu papírů, které mě nutí si myslet, že tyto westernové skvrny nevypadají jako skutečné - ale není tam žádná kuřácká zbraň," říká Bik. "Můžete říct jen to, že vypadají divně, a to samozřejmě není dostatečný důkaz, abyste kontaktovali redaktora."

Existují však známky toho, že v publikovaných rukopisech se objevují postavy generované AI. V článcích přibývá textů napsaných pomocí nástrojů jako ChatGPT, což je patrné z typických frází chatbotů, které autoři zapomínají odstranit, a charakteristických slov, která modely umělé inteligence používají. „Musíme tedy předpokládat, že k tomu dochází také u dat a obrázků,“ říká Bik.

Dalším náznakem toho, že podvodníci používají sofistikované zobrazovací nástroje, je to, že většina problémů, které vyšetřovatelé v současnosti nacházejí, se objevuje v dílech, která jsou několik let stará. „V posledních letech jsme zaznamenali stále méně problémů s obrázky,“ říká Bik. "Myslím, že většina lidí, kteří byli přistiženi při manipulaci s obrázky, začala vytvářet čistší obrázky."

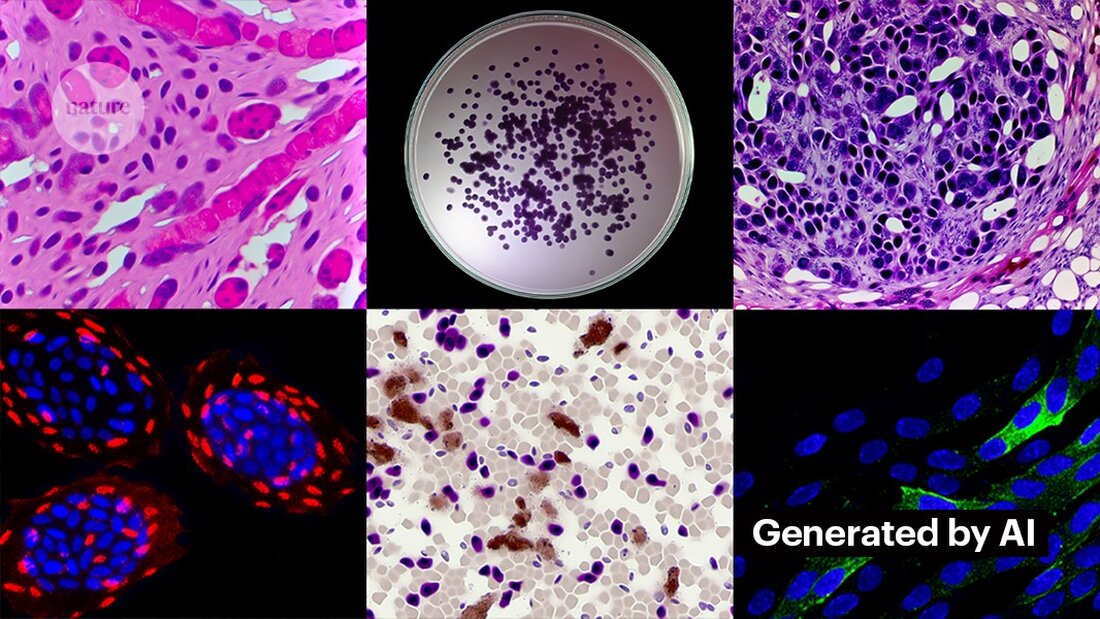

Vytváření čistých obrázků s generativní AI není obtížné. Kevin Patrick, vědecký obrazový detektiv známý jako Cheshire na sociálních sítích, předvedl, jak snadné to může být, a své poznatky zveřejnil na webu X. Pomocí AI nástroje Photoshopu Generative Fill vytvořil Patrick realistické obrázky – které by se mohly objevit ve vědeckých pracích – nádorů, buněčných kultur, Western blotů a dalších. Vytvoření většiny obrázků trvalo méně než minutu (viz „Generování falešné vědy“).

„Pokud to dokážu já, pak to jistě udělají i ti, kteří jsou placeni za vytváření falešných dat,“ říká Patrick. "Pravděpodobně existuje spousta dalších dat, která by mohla být generována pomocí nástrojů, jako je tento."

Někteří vydavatelé hlásí, že v publikovaných studiích našli důkazy o obsahu generovaném umělou inteligencí. To zahrnuje PLoS, který byl upozorněn na podezřelý obsah a našel důkazy o textu a datech generovaných umělou inteligencí v článcích a příspěvcích prostřednictvím interního vyšetřování, říká Renée Hoch, redaktorka týmu pro etiku publikací PLoS v San Franciscu v Kalifornii. (Hoch poznamenává, že použití umělé inteligence není v časopisech PLoS zakázáno a že zásady umělé inteligence jsou založeny na odpovědnosti autora a transparentním zveřejnění.)

Další nástroje by také mohly poskytnout příležitosti pro lidi, kteří chtějí vytvářet falešný obsah. Minulý měsíc výzkumníci zveřejnili a 1 generativní model umělé inteligence k vytváření mikroskopických snímků s vysokým rozlišením – a někteří specialisté na integritu vyjádřili obavy ohledně této práce. „Tuto technologii mohou snadno použít lidé se špatnými úmysly k rychlému vytvoření stovek nebo tisíců falešných obrázků,“ říká Bik.

Yoav Shechtman z Technion–Israel Institute of Technology v Haifě, tvůrce nástroje, říká, že nástroj je užitečný pro vytváření trénovacích dat pro modely, protože snímky z mikroskopu s vysokým rozlišením je obtížné získat. Ale dodává, že to není užitečné pro generování padělků, protože uživatelé mají malou kontrolu nad výsledky. Stávající software pro úpravu obrázků, jako je Photoshop, je užitečnější pro manipulaci s postavami, navrhuje.

I když to lidské oči možná nezvládnou Rozpoznejte obrázky generované AI, umělá inteligence by to mohla udělat (viz „Obrázky AI je obtížné rozpoznat“).

Vývojáři nástrojů jako Imagetwin a Proofig, které používají AI k detekci problémů integrity ve vědeckých obrázcích, rozšiřují svůj software o filtrování obrázků vytvořených generativní AI. Protože jsou takové obrázky tak těžké rozpoznat, obě společnosti vytvářejí své vlastní databáze generativních obrázků AI, aby trénovaly své algoritmy.

Společnost Proofig již vydala funkci ve svém nástroji pro rozpoznávání snímků mikroskopu generovaných umělou inteligencí. Spoluzakladatel Dror Kolodkin-Gal z Rehovotu v Izraeli říká, že při testování s tisíci AI generovanými a skutečnými obrázky z článků algoritmus správně identifikoval obrázky AI v 98 % případů a měl falešnou pozitivitu 0,02 %. Dror dodává, že tým se nyní snaží pochopit, co přesně jejich algoritmus detekuje.

„Vkládám do těchto nástrojů velké naděje,“ říká Christopher. Poznamenává však, že jejich výsledky musí vždy hodnotit odborníci, kteří mohou ověřit problémy, které indikují. Christopher zatím neviděl žádné důkazy o tom, že by software pro rozpoznávání obrazu AI byl spolehlivý (interní hodnocení společnosti Proofig dosud nebylo zveřejněno). Tyto nástroje jsou „omezené, ale určitě velmi užitečné, protože nám umožňují škálovat naše úsilí o kontrolu podání,“ dodává.

Mnoho vydavatelů a výzkumných institucí jej již využívá Důkaz a Imagetwin. Například vědecké časopisy používají Proofig ke kontrole problémů s integritou obrázků. Podle Meagan Phelanové, ředitelky komunikace pro vědu ve Washingtonu DC, nástroj zatím neobjevil žádné obrázky generované umělou inteligencí.

Springer Nature, vydavatel Nature, vyvíjí vlastní nástroje pro detekci textu a obrázků, nazvané Geppetto a SnapShot, které označují nesrovnalosti, které jsou následně vyhodnocovány lidmi. (Tým Nature news je redakčně nezávislý na svém vydavateli.)

Vydavatelské skupiny také podnikají kroky, aby reagovaly na obrázky generované AI. Mluvčí Mezinárodní asociace vědeckých, technických a lékařských vydavatelů (STM) v Oxfordu ve Spojeném království uvedl, že tento problém bere „velmi vážně“ a reaguje na iniciativy, jako je např. United2Act a STM Integrity Hub, který řeší aktuální problémy s povinným publikováním a další problémy akademické integrity.

Christopher, který vede pracovní skupinu STM pro úpravy a duplikace obrázků, říká, že existuje stále větší povědomí o tom, že bude nutné vyvinout způsoby, jak ověřit nezpracovaná data – například označováním snímků pořízených mikroskopem neviditelnými vodoznaky podobnými těm, které se používají Vodoznaky v textech generovaných AI – to by mohla být správná cesta. To vyžaduje nové technologie a nové standardy pro výrobce zařízení, dodává.

Patrick a další se obávají, že vydavatelé nejednají dostatečně rychle, aby čelili hrozbě. „Obáváme se, že to bude jen další generace problémů v literatuře, kterou se nebudou zabývat, dokud není příliš pozdě,“ říká.

Někteří jsou však optimističtí, že obsah generovaný umělou inteligencí, který se dnes objevuje v článcích, bude objeven v budoucnu.

„Pevně věřím, že se technologie zlepší do té míry, že rozpozná data, která se dnes vytvářejí – protože v určitém okamžiku to bude považováno za relativně hrubé,“ říká Patrick. "Podvodníci by neměli v noci dobře spát. Mohli by oklamat současný proces, ale nemyslím si, že mohou tento proces oklamat navždy."

-

Saguy, A. a kol. Malý pervitin. https://doi.org/10.1002/smtd.202400672 (2024).

Suche

Suche

Mein Konto

Mein Konto