研究人员利用天文学技术来创建计算机生成的 “Deepfake”图像 识别 - 乍一看可能与真实照片相同。

通过分析通常用于研究遥远星系的面部图像,天文学家可以测量人的眼睛如何反射光线,这可以表明图像操纵的迹象。

英国赫尔大学数据科学、人工智能和建模中心主任 Kevin Pimbblet 表示:“这不是万能药,因为我们存在误报和漏报的情况。”他在 7 月 15 日的皇家天文学会全国天文学会议上介绍了这项研究。“但这项研究提供了一种潜在的方法,向前迈出了重要的一步,有可能增加可用于查明图像真假的测试。”

表达的照片

人工智能 (AI) 的进步使得区分真实图像、视频和音频变得越来越困难 由算法创建的 ,认识。 Deepfakes 用其他人或环境的特征替换了其他人或环境的特征,可以使人看起来好像说过或做过他们没有说过或做过的事情。当局警告称,这项技术正在军事化,并导致错误信息的传播, 例如在选举期间 ,可以使用。

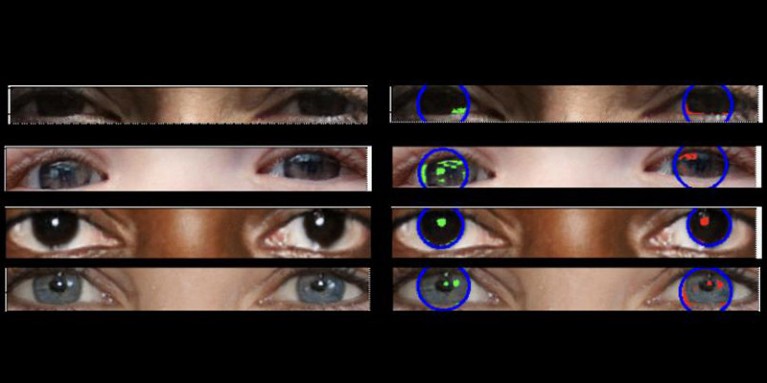

真实的照片应该具有“一致的物理特性”,皮姆布莱特解释说,“因此你在左眼中看到的反射应该与右眼中的反射非常相似,尽管不一定相同。”这些差异是微妙的,因此研究人员转向分析天文图像中的光而开发的技术。

这部尚未出版的作品构成了阿德朱莫克·奥沃拉比 (Adejumoke Owolabi) 硕士论文的基础。英国赫尔大学的数据科学家奥沃拉比(Owolabi)从 Flickr Faces HQ 数据集 并使用图像生成器创建假脸。然后,奥沃拉比使用两种天文测量方法(CAS 系统和基尼指数)分析了图像中眼睛中光源的反射。 CAS 系统量化物体光分布的集中度、不对称性和平滑度。几十年来,这项技术使包括皮姆布莱特在内的天文学家能够表征河外恒星的光。基尼指数衡量星系图像中光分布的不均匀性。

通过比较人眼球的反射,Owolabi 能够在大约 70% 的情况下正确预测图像是否是假的。最终,研究人员发现基尼指数比 CAS 系统更能预测图像是否被操纵。

加州大学圣克鲁斯分校的天体物理学家布兰特·罗伯逊对这项研究表示欢迎。 “但是,如果你可以计算出一个值来量化深度伪造图像的真实程度,那么你还可以通过优化该值来训练人工智能模型来生成更好的深度伪造图像,”他警告说。

英国南安普顿大学人工智能研究员黄志武表示,他自己的研究尚未发现深度伪造图像的眼睛中存在任何不一致的光模式。但是“虽然使用眼球不一致反射的特定技术可能不会广泛适用,但这种技术对于分析图像不同部分的光照、阴影和反射的细微异常可能很有用,”他说。 “检测光物理特性的不一致可以补充现有方法并提高深度伪造检测的整体准确性。”

Suche

Suche

Mein Konto

Mein Konto